Wenn Sie mit der Keras-Bibliothek arbeiten und Tensorboard zum Drucken Ihrer Genauigkeitsdiagramme und anderer Variablen verwenden möchten, gehen Sie wie folgt vor.

Schritt 1: Initialisieren Sie die Keras-Rückrufbibliothek mit dem folgenden Befehl, um Tensorboard zu importieren

from keras.callbacks import TensorBoard

Schritt 2: Fügen Sie den folgenden Befehl direkt vor dem Befehl "model.fit ()" in Ihr Programm ein.

tensor_board = TensorBoard(log_dir='./Graph', histogram_freq=0, write_graph=True, write_images=True)

Hinweis: Verwenden Sie "./graph". Der Diagrammordner wird in Ihrem aktuellen Arbeitsverzeichnis generiert. Vermeiden Sie die Verwendung von "/ graph".

Schritt 3: Fügen Sie einen Tensorboard-Rückruf in "model.fit ()" ein. Das Beispiel ist unten angegeben.

model.fit(X_train,y_train, batch_size=batch_size, epochs=nb_epoch, verbose=1, validation_split=0.2,callbacks=[tensor_board])

Schritt 4: Führen Sie Ihren Code aus und prüfen Sie, ob sich Ihr Diagrammordner in Ihrem Arbeitsverzeichnis befindet. Wenn die oben genannten Codes korrekt funktionieren, befindet sich in Ihrem Arbeitsverzeichnis der Ordner "Graph".

Schritt 5: Öffnen Sie Terminal in Ihrem Arbeitsverzeichnis und geben Sie den folgenden Befehl ein.

tensorboard --logdir ./Graph

Schritt 6: Öffnen Sie nun Ihren Webbrowser und geben Sie die folgende Adresse ein.

http://localhost:6006

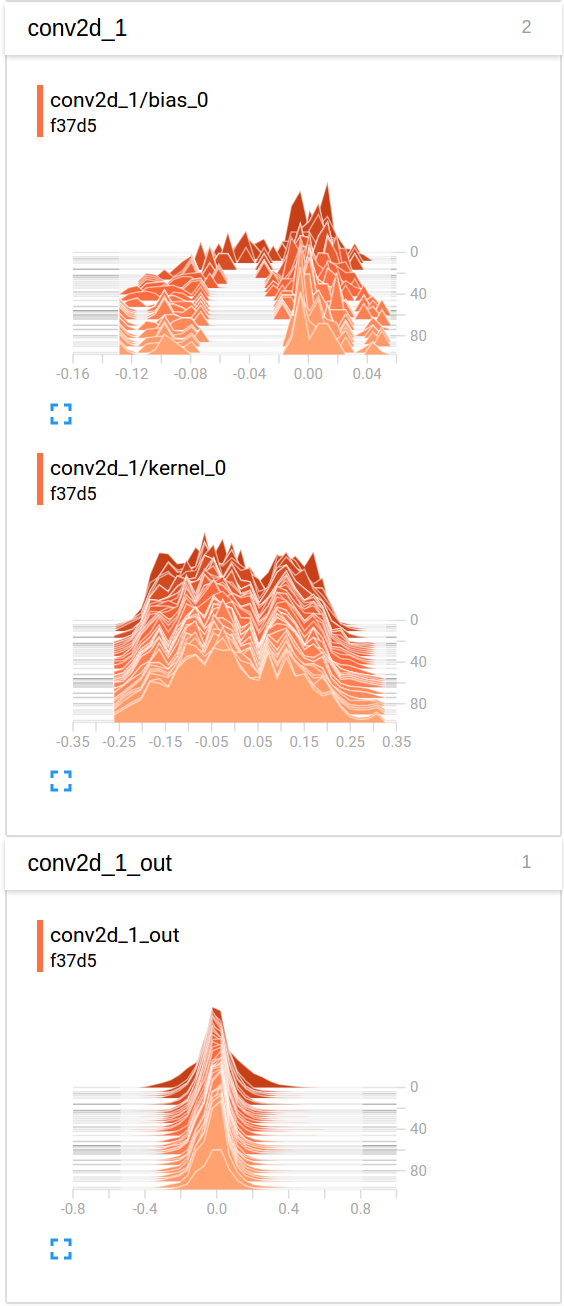

Nach der Eingabe wird die Tensorbaord-Seite geöffnet, auf der Sie Ihre Diagramme verschiedener Variablen sehen können.

histogram_freqzu1. "histogram_freq: Häufigkeit (in Epochen), mit der Aktivierungshistogramme für die Ebenen des Modells berechnet werden. Wenn der Wert auf 0 gesetzt ist, werden Histogramme nicht berechnet."